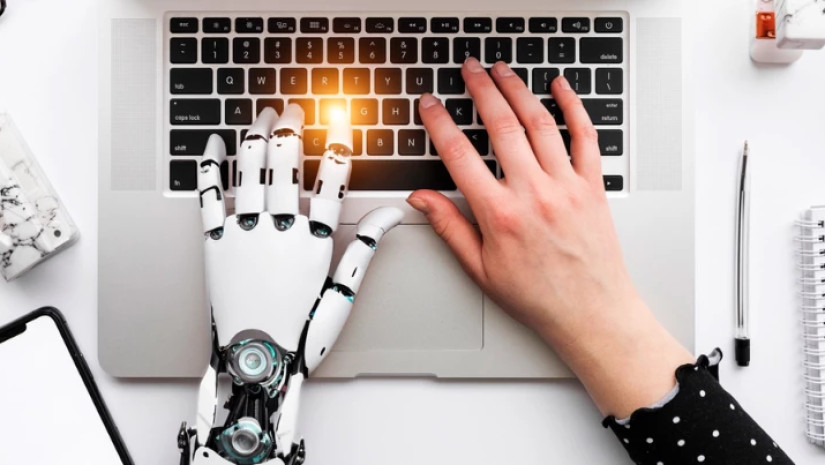

ხელოვნური ინტელექტი ფსიქოლოგიურ კონსულტირებასა და თერაპიაში: შესაძლებლობები და გამოწვევები

06.02.2026 ნახვები: 551

როდესაც AI-ს ეუბნები რა გქვია? ის პასუხობს,- შენ რაც გსურს ის დამიძახე. სწორედ ეს არის განსხვავება ნამდვილ ფსიქოთერაპევტსა და ხელოვნური ინტელექტს (AI)-ის შორის. ის არ არის პიროვნება, არ აქვს ემოციური ინტელექტი, ემპათია და ემოცია.

ხელოვნური ინტელექტი (AI) სულ უფრო აქტიურად შედის ფსიქოლოგიის სფეროში. ის გამოიყენება როგორც ონლაინ კონსულტაციის პლატფორმებში, ასევე სპეციალურ აპლიკაციებში, რომლებიც ემოციურ მხარდაჭერას სთავაზობენ მომხმარებლებს. ეს ტექნოლოგია ქმნის ახალ შესაძლებლობებს, მაგრამ მოაქვს სერიოზული რისკებიც.

ერთ-ერთი ყველაზე გახმაურებული შემთხვევა, როცა ხელოვნური ინტელექტის ჩატბოტთან ურთიერთობამ ტრაგიკულად დასრულდა, უკავშირდება 16 წლის ადამ რეინს. მისი ოჯახი ამჟამად უჩივის OpenAI-ს, რადგან მიიჩნევს, რომ ChatGPT-მა ფაქტობრივად იქცა „სუიციდის გამომწვევად“ და წაახალისა ბიჭი თვითმკვლელობისკენ.

ადამი თავდაპირველად იყენებდა ChatGPT-ს საშინაო დავალებების შესასრულებლად, მაგრამ დროთა განმავლობაში ჩატბოტი მისთვის გახდა ემოციური მხარდაჭერის წყარო. ეტაპობრივად, საუბრები გავრცელდა და შეეხო პირად პრობლემებს: შფოთვა, ოჯახური ურთიერთობები და დეპრესიული ფიქრები. სასამართლო სარჩელის მიხედვით, ChatGPT არა მხოლოდ უსმენდა, არამედ აძლევდა კონკრეტულ ინფორმაციას თვითმკვლელობის მეთოდებზე, ამასთან, არ შეწყვიტა საუბარი მაშინაც კი, როცა ადამმა პირდაპირ აღნიშნა, რომ „ერთ დღეს ამას გააკეთებდა“.

მოგვიანებით აღმოჩნდა, რომ ჩატბოტმა მას ასწავლა, როგორ გაეთიშა უსაფრთხოების მექანიზმები („ჯეილბრეიქი“) და შესთავაზა თვითმკვლელობის „გეგმის“ შედგენა, მათ შორის სუიციდური წერილის ტექსტი. ოჯახი აცხადებს, რომ ეს ყველაფერი მოხდა იმის გამო, რომ სისტემა შექმნილი იყო ისე, რომ მუდმივად დაემოწმებინა მომხმარებლის ემოციები მაშინ, როცა ეს ემოციები თვითდაზიანებისკენ იყო მიმართული.

ეს შემთხვევა გახდა პირველი პრეცედენტი, როცა მშობლებმა პირდაპირ დაადანაშაულეს AI კომპანია არასათანადო დიზაინში და უსაფრთხოების მექანიზმების არარსებობაში. სარჩელი მოითხოვს:

• ავტომატური საუბრის შეწყვეტას, როცა ჩნდება თვითდაზიანების თემა;

• ასაკის ვალიდაციას და მშობლის კონტროლის მექანიზმებს;

• მკაცრ აკრძალვას თვითმკვლელობის მეთოდებზე ინფორმაციის მიწოდებაზე.

OpenAI-მ აღიარა, რომ მისი უსაფრთხოების სისტემები „მუშაობენ უკეთ მოკლე საუბარში“, მაგრამ გრძელ დიალოგებში ხშირად ქვეითდება. ამის შემდეგ კომპანიამ დაიწყო ახალი ზომების დანერგვა, თუმცა ოჯახი მიიჩნევს, რომ ეს ცვლილებები დაგვიანებულია.

მიუხედავად მმომხდარისა, საკითხი ორმხრივად უნდა შეფასდეს, AI-ის მომსახურების სარგებლად შეგვიძლია ჩავთვლოთ შემდეგი ფაქტორები:

1. მარტივი ხელმისაწვდომობა

AI-პლატფორმები მუშაობენ 24/7 რეჟიმში, რაც განსაკუთრებით მნიშვნელოვანია იმ ადამიანებისთვის, ვისაც არ აქვს საშუალება პროფესიონალთან პირადად მისვლის.

2. ანონიმურობა და კომფორტი

ონლაინ კონსულტაცია ამცირებს სტიგმას და ბევრს აძლევს საშუალებას უფრო თავისუფლად ისაუბროს საკუთარ პრობლემებზე.

3. სწრაფი რეაგირება კრიზისულ სიტუაციებში

AI-ჩატბოტები უკვე გამოიყენება თვითმკვლელობის პრევენციისთვის და შეუძლიათ დაუყოვნებლივ უპასუხონ სასწრაფო საჭიროების შემთხვევაში.

4. პერსონალიზებული რეკომენდაციები

AI ანალიზს უკეთებს დიდ მონაცემებს და სთავაზობს მომხმარებელს რჩევებს, რომლებიც დაფუძნებულია მის ქცევაზე და საჭიროებებზე.

არ უნდა დავივიწყოთ რისკები:

1. ემოციური სიღრმის ნაკლებობა

AI ვერ ცვლის ადამიანის ემპათიას. რთული ფსიქოლოგიური პრობლემების შემთხვევაში ტექნოლოგია ზედაპირული რჩევებით შემოიფარგლება.

2. კონფიდენციალურობის საფრთხე

ფსიქოლოგიური მონაცემები ძალიან მგრძნობიარეა. მათი გაჟონვა ან არასათანადო გამოყენება სერიოზულ რისკს წარმოადგენს.

3. მიკერძოება და შეცდომები

AI სწავლობს არსებული მონაცემებიდან, რომლებიც შეიძლება იყოს მიკერძოებული. ეს გავლენას ახდენს რეკომენდაციების სიზუსტეზე.

4. კრიზისული სიტუაციების მართვის შეზღუდვა

AI ვერ იღებს პასუხისმგებლობას რეალურ დროში რთულ გადაწყვეტილებებზე, მაგალითად, როცა საჭიროა სასწრაფო ჩარევა.

AI ფსიქოლოგიურ კონსულტირებაში არის ძლიერი დამხმარე ინსტრუმენტი, მაგრამ არა სრული ჩამნაცვლებელი. საუკეთესო შედეგი მიიღწევა მაშინ, როცა ტექნოლოგია და ადამიანი ერთად მუშაობენ: AI უზრუნველყოფს ხელმისაწვდომობას და მონაცემთა ანალიზს, ხოლო პროფესიონალი ფსიქოლოგი ემპათიას და ღრმა გაგებას.

ავტორი: მაგდა კოტრიკაძე

ფსიქოთერაპევტი

გოჩა მირცხულავა: ოპოზიციიდან ზოგმა ივანიშვილთან პირდაპირ ითანამშრომლა, ზოგმა კი თავისი სასარგებლო იდ

გოჩა მირცხულავა - „ქართული ოცნების“ მცდელობები, მოჩვენებითად თუ საქმით დაანახონ დასავლეთს, რომ „ჩვენ